Brugere af generative AI-tjenester er digitale hælere

ChatGPT, Gemini, Llama, CoPilot og Mistral er i gang med at slå én hel industri ihjel for at opbygge en ny, som primært forgylder de i forvejen velpolstrede tech-virksomheder

"Den ulicenserede brug af kreative værker til træning af generativ AI er en stor og uretfærdig trussel mod levebrødet for skaberne bag disse værker og bør ikke tillades."

Sådan lyder en ny underskriftsindsamling med kendte musikere og forfattere i front. Journalister, fotografer, designere, grafikere og alle andre kunstnere, hvis arbejde normalt er beskyttet af ophavsretten, skriver også under - endnu en gang - samtidig med at et utal af retssager er indledt overfor for virksomhederne bag generativ AI-tjenester.

Ingen har spurgt om lov til at bruge indhold fra nettet

OpenAI har brugt indholdet på internettet til at skabe og udvikle ChatGPT. Det samme har Google med Gemini. Meta med Llama. Anthropic med Claude. Og så er der Mistral, Perplexity og mange mange flere, der gør det samme. Microsoft er storinvestor i både OpenAI og Mistral og deres CoPilot er således bygget på ChatGPT.

Ingen af disse virksomheder har på forhånd spurgt om tilladelse til at bruge andres indhold. De fleste siger, at de bruger 'offentligt tilgængeligt indhold' og de mener det er lovligt og fair. Alle - også Llama, som Meta løgnagtigt kalder open source - er lukkede som bankbokse på spørgsmål om, hvilket indhold de helt konkret har trænet deres tjenester på.

Det er ret vildt. En over-hypet ny industri, generativ AI, er etableret ovenpå andres arbejde, og det har stået på i over to år. Mange indholdsskabere og kunstnere har ændret deres juridiske betingelser og forsøgt teknisk at blokerer for yderligere træning, men ingen haft succes med at stoppe misbruget.

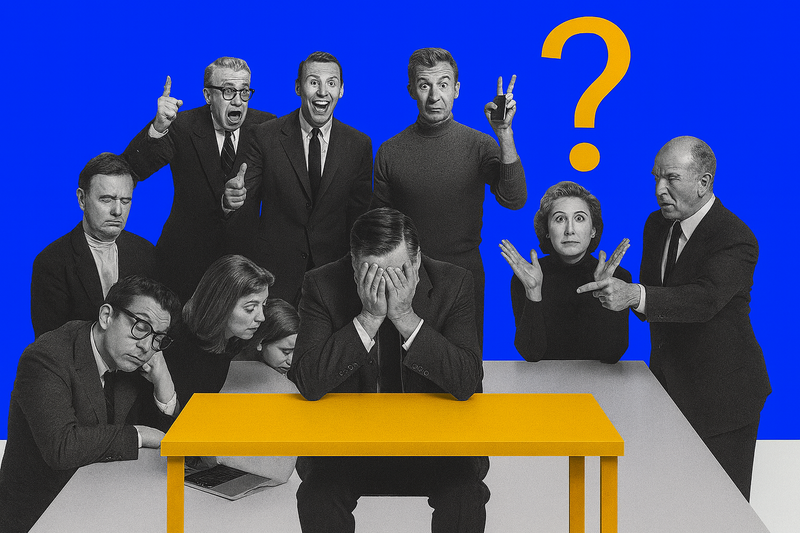

Tværtimod har generativ AI stærk medvind. En danske minister mener, at alle statens ansatte skal have adgang til CoPilot, kommunerne eksperimenter løs og selv virksomheder, der selv går vildt op i misbrug af deres egne varemærker, bruger GenAI tjenesterne.

Masser af konsulenter er dukket op som en slags prædikanter, der vil lære os at prompte rigtigt, for det handler om at komme først - ikke bedst - og så har de jo fundet en god levevej.

Overgreb på ophavsretten

Der er tale om et kæmpe overgreb på ophavsretten - et decideret tyveri, som Naomi Klein kalder det i The Guardian - overfor en hel masse skabere, der er tvunget til at bruge tid og ofte meget sparsomme ressourcer på at forsvare deres ret til at bestemme over eget indhold og værker.

Der er masser af retssager i gang, og heldigvis går de store forrest, selv om de er små overfor techgiganterne. Den mest profilerede sag er The New York Times mod OpenAI og Microsoft.

Getty Images har sagsøgt Stability AI, der står bag Stable Diffusion, og de amerikanske forfatteres organisation Authors Guild har også lagt sag an mod OpenAI. Listen er ufattelig lang og samles her i en Ophavsret-trackerover sagerne i USA.

De vil tabe sagerne pga. fair-use doktrinen

I netop USA er der en vis risiko for, at mange af sagerne vil blive tabt. I den amerikanske ophavsretlov findes nemlig en klausul, 'fair use', som Google en gang vandt på, da de lavede Google Books. Forskellen fra den sag og nu er dog, at Google Books ikke kostede penge. Derfor er det så vigtigt for AI-virksomhederne at give gratis versioner af deres tjenester (hvor man så til gengæld betaler med sine data).

Netop fair-use doktrinen er Microsofts forsvar. Giganten, der gennem de sidste mange år har markedsført sig på etisk ansvarlig brug af kunstig intelligens og sidder inde i de fleste regerings-og virksomhedscomputere, hævder, at der er tale om fair use og skynder sig at få så mange som muligt til at bruge CoPilot inden at retssagerne afgøres.

I Europa har vi ikke en fair-use klausul i ophavsretslovgivningen. Men big AI techs dygtige advokater skal nok gøre alt for at finde gode argumenter for at kunne bruge andres værker i innovationens navn. Ingen euopæiske ophavsretshavere har endnu lagt sag an mod dem. De danske medier har varslet det i the Wired, men det er dyrt og langvarigt at gå igang med sådanne sager.

Menneskeskabt indhold er guld

Det er meget vigtigt for især tekstbaseret generativ AI at træne deres tjenester på menneskeskabt faktatjekket indhold fremfor f.eks. løse rygter på sociale medier, og derfor har nogle medier indgået licens-aftaler med f.eks. OpenAI om lovlig brug af deres indhold.

Det er dog typisk kortvarige aftaler, hvor OpenAI får adgang til fulde arkiver, som de så kan træne på, så længe de har en aftale. Tiden vil vise, om det nu også er en god ide for medievirksomhederne at indgå disse aftaler. De risikerer en dårlig version af en Spotify-løsning, hvor flere og flere stopper med at betale for digitalt indhold, fordi de kan få det hele via f.eks. ChatGPT eller Google.

Selv om Silicon-valley firmaerne skulle vinde ophavsretssagerne (modsat i Kina, hvor dommere har afgjort, at der er tale om en krænkelse af ophavsretten) kan man godt hævde, at det er dybt uetisk at bruge andres indhold til at bygge noget nyt op uden at spørge om lov og dele indtægterne.

Og hvad med alle os, der bruger disse produkter, fordi vi er nødt til at følge med, fordi ens arbejdsgiver kræver det eller en helt tredje årsag? Vi er jo digitale hælere!

Ophavsretten er kun ét problem

Med listen af andre etiske problemer drukner ophavsretsproblemet måske. Bare for at nævne nogle få andre problemer: Generativ AI skaber misinformation (de hallucinerer - et pænt ord for at lyve) og bruges til fake news, så vi ikke længere kan se forskel. De krænker privatlivets fred, der er masser af bias og diskrimination, de er bevidst designet menneskelignende, så nogle bliver forført og manipuleret, og de er nogle kæmpe klimasyndere.

Heldigvis er mange aktører i gang med at opbygge etisk ansvarlige sprogmodeller. Organisationen Fairlytrained.org peger på dem, hvor ophavsretten ikke krænkes. Billedgeneratoren Firefly.adobe.com har i langt de fleste tilfælde fået tilladelse af skaberne og kan faktisk konkurrere med OpenAIs Dall-E.

I Finland arbejder Silo.ai på en germansk model, der er flere tyske enheder med tyske statsstøtte i gang, og i Danmark har har vi Dansk Sprogmodel Korsortium, som Dansk Erhverv og Alexandra Instituttet står bag.

Så på et tidspunkt kommer modeller, som vi alle kan bruge uden at krænke nogens ophavsret. Spørgsmålet er om de nogensinde kommer til at kunne konkurrere med de uetiske tjenester.