Hvad er din P(doom)?

Måske ikke lige et spørgsmål, du bliver stillet hver dag, men det er det i Silicon Valley, hvor svaret på spørgsmålet siger en del om dit syn på kunstig intelligens (AI) og menneskehedens mulighed for at overleve med kunstig intelligens.

P(doom) betyder ”Sandsynligheden for verdens undergang (som en følge af AI)”, og svaret udtrykkes som et tal mellem 1 og 100, hvor 100 betyder, at Skynet allerede har opnået bevidsthed og lige nu er i gang med at dreje nøglerne til verdens samlede atomarsenaler, og 1 betyder, at kunstig intelligens aldrig kommer til at bøje det mindste hår på menneskeheden.

Tech-fyrster og den grå suppe

At man overhovedet kan stille spørgsmålet, og at samtaler om P(doom) faktisk bliver taget seriøst, siger en del om den fænomenale hype, der er opstået omkring AI de seneste par år. I den ene ende af skalaen har vi tech-fyrster, der skændes om, hvorvidt AI kommer til at redde eller udslette menneskeheden.

I den anden ende af skalaen har vi forskere og meningsdannere, som mener at AI er komplet ubrugeligt, ulovligt og sundhedsskadeligt. Og indimellem har vi en grå suppe af folk, der er skeptiske, optimistiske, tvivlende, håbefulde eller slet og ret grundigt forvirrede.

Nogle vil nok finde denne metadebat om AI esoterisk eller bare ligegyldig. Kan vi ikke bare være ligeglade med hvad Sam Altman eller Elon Musk mener om verdens snarlige undergang og komme i gang med at prompte os frem til nogle federe Powerpoint-præsentationer?

Tech-giganternes arbejde har reel betydning for os

Problemet er, at tech-branchens vidtløftige samtaler om P(doom), singulariteter, scaling laws og så videre har reel betydning for vores fælles fremtid med AI. Tænk på at virksomheden OpenAI, der i dag er den førende AI-udvikler faktisk blev stiftet som en non-profit-virksomhed, der skulle forhindre, at AI udviklede sig til en dommedagsmaskine.

Og tænk på, at adskillige tech-virksomheder lige nu er i gang med at bygge og genstarte atomkraftværker for at få energi nok til at drive de AI’er, som de mener kommer til at kunne løse klimakrisen.

Visionerne og troen på, hvordan AI vil udvikle sig i fremtiden, har konkret betydning for, hvordan den fremtid kommer til at se ud, hvordan vi kommer til at interagere med AI, og hvem der kommer til at sidde med magten og de gode kort på hånden.

Derfor får du her Peter Svarres autoritative (men stærkt subjektive) guide til at forstå, hvem der mener hvad om AI.

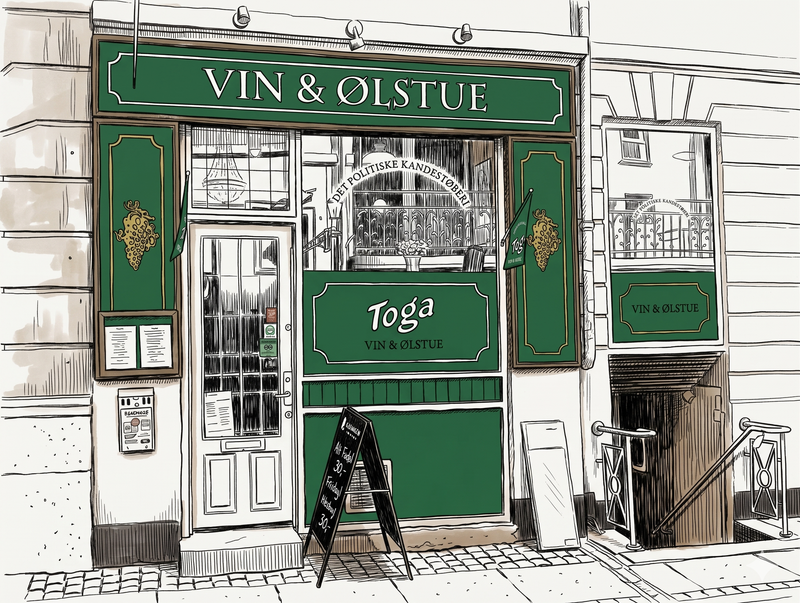

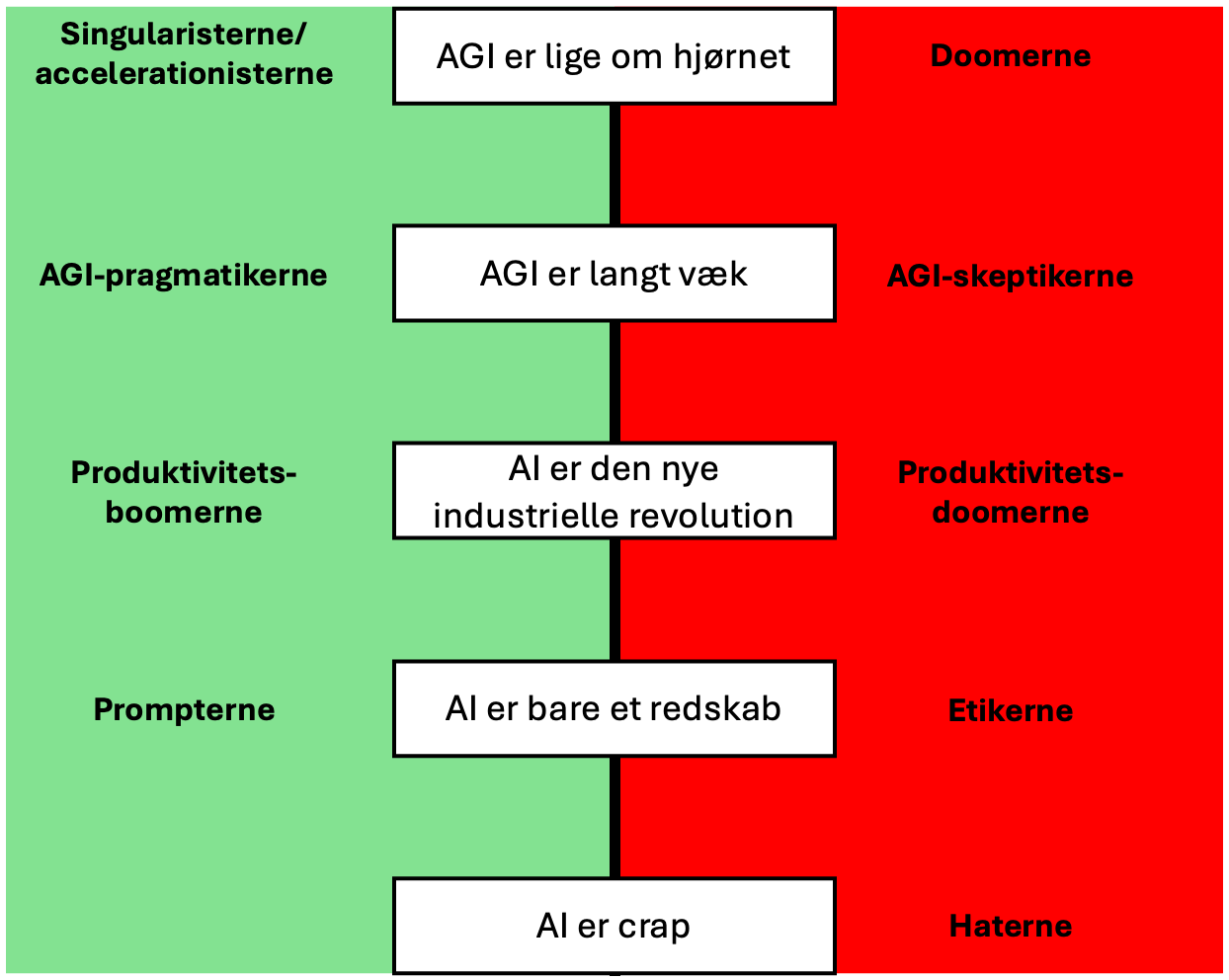

En skala med fem trin

Guiden bygger på en ganske simpel skala med fem trin. I bunden af skalaen har vi dem, der betragter AI som komplet ligegyldig og spild af tid, og i toppen af skalaen har vi dem, der tror på, at AI er snublende tæt på at blive superintelligent eller AGI (artificial general intelligence), som betyder, at AI bliver lige så god som mennesker til at udføre en bred vifte af opgaver.

For hver af de fem skalatrin er der (med en enkelt undtagelse) folk, der er optimistiske, og folk der er pessimistiske, hvilket betyder, at vi ender med 9 grupperinger af mennesker, der har forskellige holdninger og derfor også prioriteringer i forhold til AI.

I toppen af modellen...

Lad os starte i toppen, fordi her finder vi de mest højtråbende, magtfulde og pengestærke aktører.

I toppen af skalaen finder vi dem, som uden at blinke tror på, at AGI eller superintelligens er lige om hjørnet, hvilket vil sige, at de tror på, at computere bliver lige så kloge (eller klogere) som mennesker inden for 10 – 30 år.

De kigger typisk på de hastige fremskridt inden for generativ AI og ekstrapolerer disse fremskridt ud i fremtiden og forventer på den baggrund, at AGI mere eller mindre kommer af sig selv ved hjælp af teknologiens indbyggede scaling laws. Med andre ord: Kraftigere maskiner + flere data = AGI (inden for nogle få år).

Singularisterne/accelerationisterne

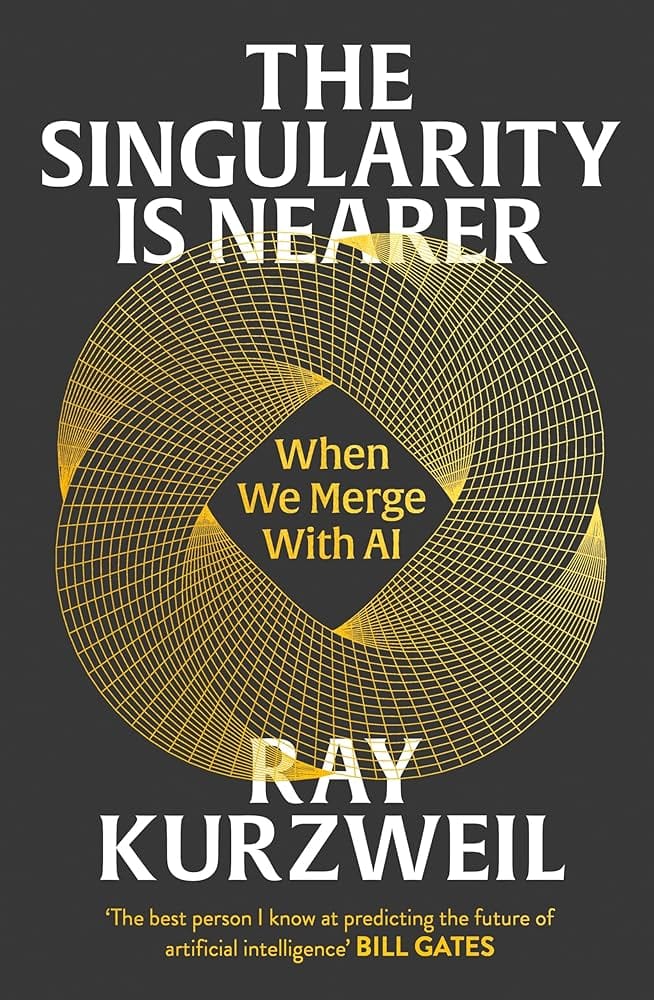

Det er typisk her oppe i toppen af skalaen, at folk ynder at tale om deres P(doom). Dem med en lav P(doom) tror på, at de snarligt superintelligente kunstige intelligenser kommer til at blive ubetinget gode for mennesker. Her finder vi for eksempel Ray Kurzweil, som i over 20 år har talt om, at kunstig intelligens lige om lidt vil overstige menneskelig intelligens.

Kurzweil tror på, at vi kommer til at smelte sammen med vores maskiner, at vi derfor kommer til at kunne leve evigt, og selvfølgelig at AI kommer til at løse stort set alle menneskehedens mest presserende problemer.

I denne gruppering finder vi også de såkaldte accelerationister, som ligeledes tror på, at AGI bliver ubetinget godt, og derfor mener de, at det er en forbrydelse mod menneskeheden, hvis man lægger hindringer i vejen for udviklingen af AI.

Vi har faktisk en moralsk forpligtelse til at accelerere udviklingen for at redde alle de mennesker, som i fremtiden kommer til at dø af sygdomme, som AI kommer til at kurere. Accelerationisterne er derfor i sagens natur stærke modstandere af politisk regulering af AI.

Doomerne

Doomerne er en lidt mere blandet skare af tech-folk, forskere og politikere, som er alvorligt bange for, at AI lige om lidt bliver superintelligent og på en eller anden måde finder en vej til at skade eller udslette menneskeheden.

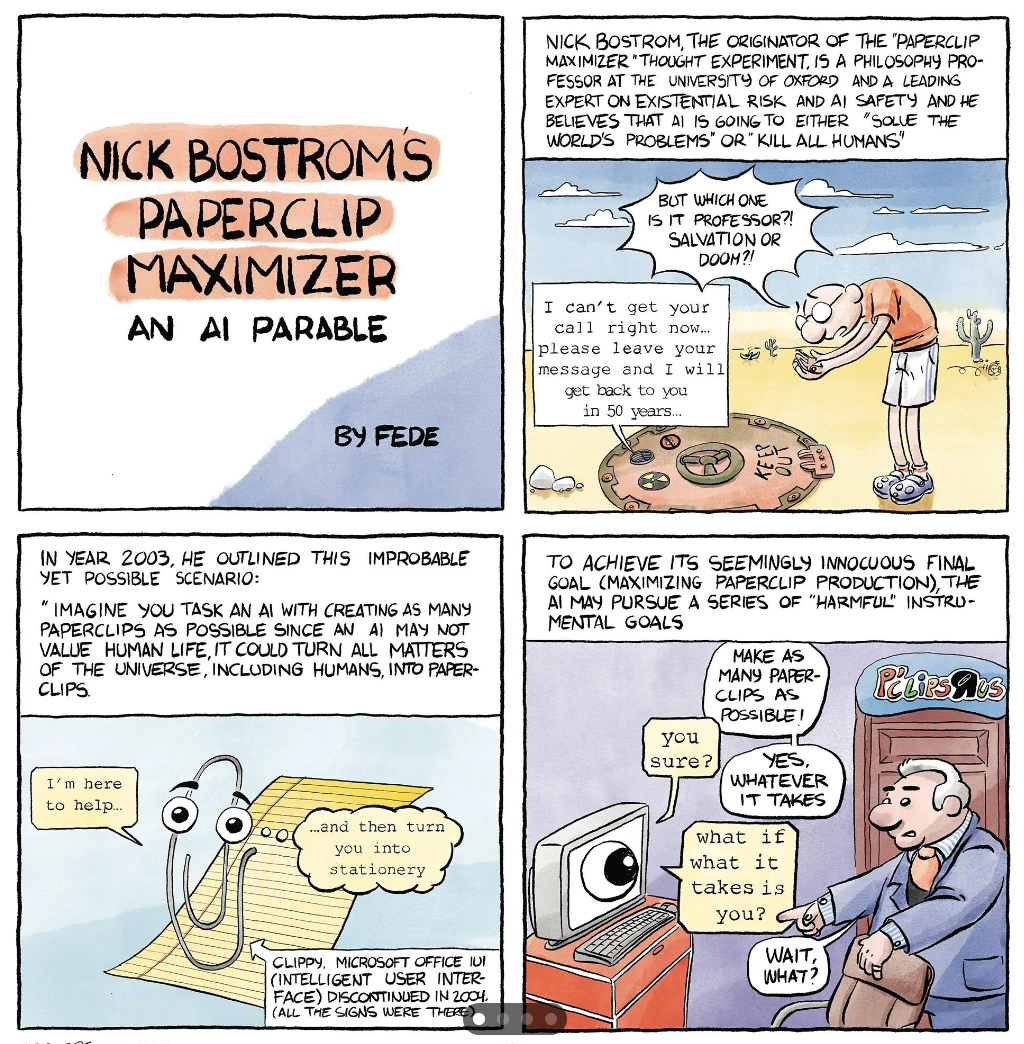

Den svenske filosof Nick Bostrom er kendt for hans papirklips-eksempel, hvor han forestiller sig, at en papirklipsfabrikants AI pludselig (af uransagelige årsager) bliver superintelligent, hvorefter den vælger at overtage verden og slå alle mennesker ihjel for at få fred og ro til at omdanne hele universet til papirklips.

Men folk som Elon Musk og en del ansatte i OpenAI og Anthropic befinder sig også i denne gruppering. De er ikke alle defaitister, og mange af dem tror, at katastrofen kan afværges, hvis man tænker sig grundigt om. De er dog typisk blodigt uenige om præcis, hvordan man undgår katastrofen.

Nogle mener, at al udvikling af AI skal foregå i det åbne, så alle kan følge med, andre mener, at man bør lukke skoderne, så terrorister og onde stater ikke får adgang til AI-teknologier.

Nogle mener, at man bør forsinke udviklingen af AI, for at vi ikke bliver løbet over ende, mens andre igen mener, at man bør forbyde og regulere bestemte typer af AI.

Faktisk forsøgte den lovgivende forsamling i Californien hen over sommeren at gennemføre regulering af AI med det sigte at undgå udviklingen af løsslupne superintelligenser. Lovgivningen blev dog bremset af guvernøren.

AGI-skeptikerne

Et trin nede af AI-hype-skalaen finder vi dem, der tror på, at AGI er en teoretisk og konkret mulighed, men det er ikke lige rundt om hjørnet. De kigger på de seneste års hype omkring generativ-AI og er imponerede over nogle af teknologiernes fremskridt, men mener stadig at der skal helt andre boller på suppen, før vi får noget, der minder om AGI.

Den mest prominente person i denne gruppering er den amerikanske psykolog og AI-ekspert, Gary Marcus, som har gjort sig selv til en af de fremmeste kritikere af Generativ AI og særligt af den fløj, som tror på, at generativ AI er sidste stop før vi udvikler rigtig AGI.

Gary Marcus fremhæver igen og igen eksempler på, hvordan generativ AI hallucinerer og grundlæggende set ikke forstår, hvordan verden hænger sammen. Marcus opfattes ofte af modstanderne som en endimensionel AI-skeptiker, men faktisk er han selv ret positiv over for, at der en dag vil komme en AGI – han tror bare, at generativ AI og sprogmodeller er lidt af en blindgyde, som vi hurtigst muligt skal komme ud af, så vi igen kan gøre fremskridt mod rigtig AGI.

AGI-pragmatikerne

Gary Marcus er meget højtråbende og polemisk i sin kritik af generativ AI og sprogmodeller. På den anden side af aksen finder vi typisk en gruppe af mere pragmatiske forskere, som er begejstrede for de seneste år fremskridt, men som ikke er grebet af Silicon Valleys hype.

Mange af dem vil sige, at AGI er en teoretisk mulighed, men vi har lige nu ikke den fjerneste idé om, hvordan vi kommer derhen, og det kan komme til at tage århundreder før det sker. I den gruppe finder vi langt de fleste af de AI-forskere, som jeg har talt med og interviewet i Danmark.

Produktivitetsboomerne

Hopper vi endnu et nøk ned af skalaen forstummer debatten om AGI. Hernede finder vi folk, som tror på, at AI er en teknologi, der på mange måde minder om dampmaskinen, som udgjorde startskuddet på den første industrielle revolution.

Det interessante ved AI er ikke om den bliver superintelligent, det interessante er dens potentiale for at automatisere menneskelige kompetencer over en meget bred vifte af industrier.

På den positive side af aksen finder vi dem, der tror på, at denne produktivitetsrevolution bliver et gode for menneskeheden. De kigger på den første industrielle revolutions fremskridt (biler, flyvemaskiner, lægevidenskab, computere osv.) og forestiller sig, at AI kommer til at starte en lignende automatiseringsrevolution, hvor mennesker – med hjælp fra AI – bliver i stand til at skabe helt nye og revolutionerende fremskridt.

Produktivitetsdoomerne

På den anden side af aksen finder vi så dem, der også kigger tilbage på den første industrielle revolution, men uddrager en langt mere negativ konklusion. Den primære frygt handler naturligvis om, at kunstige intelligenser kommer til at skabe massearbejdsløshed.

Vi ser allerede, hvordan AI har udkonkurreret programmører, læger, kundesupportere og advokater, og hvis de kunstige intelligenser bliver bare en smule klogere og mere troværdige, kunne man godt frygte for massive bølger af afskedigelser, som ville vække minder om 1930ernes arbejdsløshedskøer.

En anden mere strukturel frygt handler om, at AI (ligesom den første industrielle revolution) kommer til at skubbe til nationale og internationale magtbalancer, og at verden i værste fald kan komme helt ud af balance med katastrofale følger, som vi så for hundrede år siden under første og anden verdenskrig.

Vi ser allerede, hvordan Kinas betydning i verden er stigende som en direkte følge af landets teknologiske formåen. Og vi ser nye feudal-agtige tech-fyrster begynde at udbrede deres magt fra det teknologiske og langt ind i det politiske domæne. Et eksempel er naturlig vis Elon Musks markante indflydelse i både det amerikanske præsidentvalg og i krigen i Ukraine.

Etikerne

Atter et trin nede af skalaen finder vi forskere, politikere og meningsdannere, som er langt mere interesserede i nutiden end fremtiden. De kigger på AI og ser en teknologi, som har været under udvikling i omkring hundrede år og som allerede spiller en væsentlig rolle i vores dagligdag og på vores arbejdspladser.

Stort set alle tech-giganter og deres produkter bygger på en eller anden form for AI, så når vi chatter med vores venner, handler på internettet, kører bil eller går på arbejde, er der allerede massive mængder af AI involveret.

Etikerne er dem, der er bekymrede over alle disse AIers påvirkning af vores liv. De indsamler absurd mange data om os, de manipulerer os, de laver fejl, de hallucinerer, de er biased og så videre og så videre.

Etikerne fremhæver, hvordan AI krænker menneskerettigheder, forskyder og forstærker magthierarkier på arbejdspladser og i værste fald undergraver vores politiske systemer.

Nogle etikere er bekymrede over AI, fordi teknologien er primitiv og umoden og ofte bliver brugt til formål, hvor det slet ikke giver mening. Andre etikere frygter, at teknologien bliver for kraftfuld, så den kan bruges til at manipulere med og snyde mennesker.

Prompterne

Prompterne er også fokuserede på nutiden, og de er begejstrede. Særligt de sidste to år, har de været begejstrede over, hvordan AI er eksploderet ud af forskningslaboratorierne og ind i vores kontorer og dagligstuer, hvor ganske almindelige mennesker, nu kan lege prompt-guder med adgang til enorme mængder af datakraft og kunstig intelligens.

Prompterne er typisk fløjtende ligeglade med etik, AGI og så videre. De er bare interesserede i de seneste releases fra de mange forskellige generativ AI-modeller.

Samtalen blandt prompterne handler om, hvordan man bedst muligt prompter eller på anden vis udnytter generativ AI til at blive en nyttig hjælper i dagligdagen.

Når jeg underviser virksomheder i brugen af generativ AI, er der i en forsamling af 20 mennesker typisk altid én eller to superbegejstrede promptere, som for alvor har set lyset og bruger AI til stort set alle deres arbejdsopsgaver.

Haterne

Nederst på skalaen finder vi AI-haterne, som er en broget skare af mennesker, som bare på ingen måde kan se relevansen af AI. Og i en verden, hvor stort set alle andre er oppe køre over AI, kommer de nemt til at fremstå som en flok sure haters.

Haterne kan på den ene side være folk, der bange for AI, men det kan også være folk, der egentlig bare er lidt ligeglade, fordi de har andre værdier i deres liv end teknologiske fremskridt.

Det kan dog også være folk, der helt ontologisk er skeptiske over for, at maskiner, kan sættes til at overtage menneskelige kompetencer. De ser moderne generativ AI, som et fancy party trick, og de tror ikke på, at kunstige intelligenser for alvor kan blive sat til at spille en rolle i menneskenes verden.

Endelig er der dem, som er kritiske over for AI, fordi de mener at teknologierne er grundlæggende ulovlige og aldrig skulle være blevet bygget. Stort set al moderne AI bygger på massiv indsamling af personlige data, billeder, tekster og videoer, og de legale omstændigheder omkring al denne dataindsamling er mildest talt brogede.

Forskellige holdninger – forskellige prioritering

Som du kan se, er AI ikke bare AI. AI kan opleves og fortolkes som både en dommedagsmaskine og en nyttig hjælper til at hjælpe med børnenes matematikopgaver. Og disse forskellige opfattelser og fortolkninger har enorm betydning for, hvordan vi kommer til at leve med AI i fremtiden.

Er man accelerationist vil man desperat bekæmpe politisk regulering, er man AGI-skeptiker vil man shorte OpenAIs aktier, og hvis man er etiker, vil man dagligt forsøge at bekæmpe alle de små mikrouretfærdigheder, som siver ind i vores liv på grund af AI.

Det er dog også vigtigt at forstå, at de færreste mennesker blot tilhører én af disse grupper.